[뉴스속 용어]딥페이크 기반 기술 '생성적 적대 신경망(GAN)'

생성적 적대 신경망은 두 인공지능끼리 경쟁을 붙여 오차를 줄이고 진짜 같은 가짜 이미지, 영상, 음성 등을 구현하는 기술이다.

반면, 판별자는 주어진 데이터가 진짜인지 가짜인지 구별하는 역할을 한다.

생성자는 판별자를 속이기 위해, 판별자는 생성자가 만든 가짜 데이터를 식별하기 위해 노력한다.

AI끼리 경쟁 붙여 '진짜 같은 가짜' 구현

디지털 성범죄에 활용돼 사회적 문제 야기

생성적 적대 신경망(Generative Adversarial Networks·GAN)은 두 인공지능(AI)끼리 경쟁을 붙여 오차를 줄이고 진짜 같은 가짜 이미지, 영상, 음성 등을 구현하는 기술이다. GAN은 2014년 미국의 컴퓨터 과학자인 이안 굿펠로(Ian Goodfellow)가 신경정보처리시스템학회(NIPS)에서 처음 발표했다. GAN은 딥 러닝(Deep Learning)의 한 분야로, 딥페이크(Deepfake) 기술에 주로 사용된다.

GAN은 생성자(Generator)와 판별자(Discriminator)라는 두 개의 네트워크(인공신경망)로 이루어져 있다. 생성자와 판별자는 서로 적대적인 관계에 있다. 생성자는 실제와 유사한 데이터를 생성하는 역할을 한다. 반면, 판별자는 주어진 데이터가 진짜인지 가짜인지 구별하는 역할을 한다. 생성자는 판별자를 속이기 위해, 판별자는 생성자가 만든 가짜 데이터를 식별하기 위해 노력한다.

이안 굿펠로는 이 과정을 '경찰과 위조지폐범'의 예로 설명했다. 위조지폐범의 목표는 최대한 진짜 같은 위조지폐를 만들어 경찰을 속이는 것이다. 경찰은 위조지폐를 식별하고 범인을 검거하는 것이 목표다. 이런 상황이 계속 반복되면, 위조지폐범은 어느 순간 진짜 같은 위조지폐를 만들게 되고, 경찰은 진짜와 가짜를 구분하기 힘든 상태에 빠진다. 이처럼 두 인공신경망은 적대적이고 반복적인 학습 과정을 통해 서로의 성능을 향상시킨다.

GAN을 적용한 다양한 사례가 나왔다. 미국 빅테크(대형 정보기술 기업)인 엔비디아(NVIDIA)는 2017년 ‘실존하지 않는 사람들의 이미지’를 공개했다. 엔비디아는 GAN의 생성자와 판별자를 낮은 값부터 천천히 학습시켜 점진적으로 성장시키는 새로운 훈련 방법을 제시했다. 이를 통해 생성된 이미지는 실존 인물인지 아닌지를 구분하기 어려운 수준까지 도달했다. 같은 해 미국 워싱턴대학교 연구진이 제작한 버락 오바마 전 미국 대통령의 가짜 연설 영상도 화제였다. 이 영상은 오바마 전 대통령의 연설 영상들에서 음성을 딴 뒤 이 음성에 맞는 입 모양을 만들어 합성한 것이다.

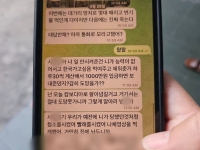

AI 아나운서, AI 대통령 선거 후보 등 긍정적인 사례와는 달리 딥페이크 기술이 디지털 성범죄에 활용되면서 사회 전반의 문제로 떠올랐다. 국내 연예인뿐 아니라 일반인의 얼굴을 음란물과 합성한 딥페이크 영상이 무분별하게 유포됐다. 이 영상을 공유하는 이른바 ‘지인능욕방’, ‘겹지인방’ 등 텔레그램방이 성행하면서 피해를 본 여성들의 걱정이 커지고 있다.

꼭 봐야 할 주요 뉴스

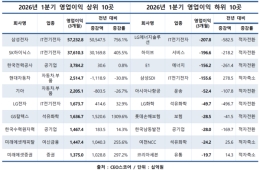

"우리도 이제 월급이 1000만원" 역대 최고…'반도...

"우리도 이제 월급이 1000만원" 역대 최고…'반도...

각국은 정부 차원의 대책을 내놓고 있다. 미국은 지난해 10월 AI가 생성한 영상·사진·음향에 의무적으로 워터마크(식별표시)를 부착하게 하는 행정명령을 발표했다. 한국은 지난달 30일 딥페이크 영상물 제작·유통에 대한 처벌 기준을 높이는 법률 개정을 추진하기로 했다. 딥페이크를 추적·탐지하는 기술도 등장했다. 2022년 인텔은 얼굴 핏줄을 분석해 96%의 정확도로 가짜 동영상을 탐지할 수 있는 ‘페이크캐처’ 기술을 공개했다. 또 지난해 미국 매사추세츠 공대(MIT) 연구팀은 이미지의 중심이 되는 픽셀을 왜곡해 AI가 이미지를 무단으로 편집하는 것을 방지하는 '포토가드'란 기술을 개발했다고 밝혔다.

<ⓒ투자가를 위한 경제콘텐츠 플랫폼, 아시아경제(www.asiae.co.kr) 무단전재 배포금지>

![경찰과 위조지폐범의 예시 [사진출처=과학기술정보통신부 블로그]](https://cphoto.asiae.co.kr/listimglink/1/2024090309370215780_1725323822.png)

![GAN 기술로 만든 오바마 전 미국 대통령의 연설 영상 [사진출처=유튜브]](https://cphoto.asiae.co.kr/listimglink/1/2024090309382815784_1725323908.png)

![생과일 아니고 착즙원액?…커피전문점 수박주스 대해부[맛잘알X파일]](https://cwcontent.asiae.co.kr/asiaresize/308/2020071609344063873_1594859680.jpg)

![[주식회사 혁명수비대]②자금력의 원천은 '비영리재단'…감사도 안받는 이유](https://cwcontent.asiae.co.kr/asiaresize/308/2026051708013065828_1778972490.jpg)

![[초동시각]애물단지가 된 필리버스터](https://cwcontent.asiae.co.kr/asiaresize/308/2026051513484496581A.jpg)

![[기자수첩]'현대판 러다이트' 멈춰선 공장의 의미](https://cwcontent.asiae.co.kr/asiaresize/308/2026051513493797137A.jpg)

![[남산길 산책]2026년 아비뇽, 세계에 선보일 K-연극](https://cwcontent.asiae.co.kr/asiaresize/308/2026051513455791682A.jpg)

!["편의점 10곳 돌아도 못 샀다" 난리…벌써 1억개 팔린 빵 정체[지금 사는 방식]](https://cwcontent.asiae.co.kr/asiaresize/308/2026051314412961326_1778650889.jpg)

!["시나몬롤 아니고 시나모롤"…열도 달군 올해 산리오 캐릭터 인기 투표 [日요일日문화]](https://cwcontent.asiae.co.kr/asiaresize/308/2026051315031561400_1778652195.png)

!["돼지국밥 먹으러 또 갈래"…대만서 등장한 '부산병'[K홀릭]](https://cwcontent.asiae.co.kr/asiaresize/308/2026051513340964879_1778819648.jpg)

![[주末머니]명품백 사는 부자는 옛말? '경험'에 돈쓰는 美고소득층](https://cwcontent.asiae.co.kr/asiaresize/308/2026051410542062757_1778723660.png)

!["구부릴수록 빛이 강해진다"…휘면 신호 3배 커지는 초박막 광소자 개발[과학을읽다]](https://cwcontent.asiae.co.kr/asiaresize/308/2026051516335665250_1778830436.jpg)

![우베 디저트 엄청 먹더니…필리핀서 '보라색 금' 취급 [맛있는 이야기]](https://cwcontent.asiae.co.kr/asiaresize/308/2026051508354264072_1778801743.jpg)

![[타보니]"최상위, 그 너머에"…메르세데스-마이바흐 GLS 600'](https://cwcontent.asiae.co.kr/asiaresize/309/2026051509582364441_1778806703.jpg)