"물리법칙으로 '춤사위' 이해·구현" KAIST, 3D 생성형 AI 개발

춤을 출 때 흔들리는 옷의 흐트러짐과 주름을 이해하고 사실적으로 그려낼 수 있는 인공지능(AI) 기술이 개발됐다.

'그럴싸하게'가 아니라 물리법칙을 학습해 실제와 같은 움직임을 포착·이해한 후 묘사하는 방식이다. 영화·메타버스·게임 아바타 등의 몰입감과 현실감을 높일 수 있어 향후 실감형 미디어 산업에 적용할 수 있을 것으로 기대된다.

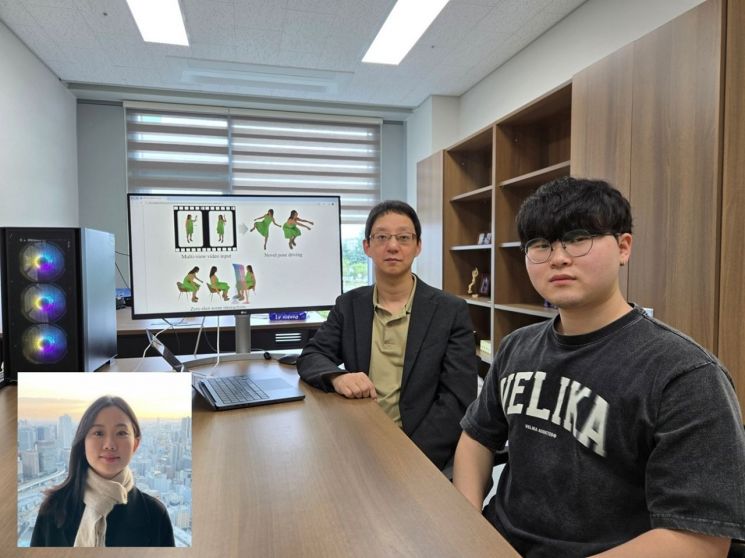

KAIST는 전산학부 김태균 교수 연구팀이 공간·물리 기반의 생성형 AI 모델 'MPMAvatar'를 개발했다고 22일 밝혔다.

연구팀은 2D 기술의 문제해결을 위해 가우시안 스플래팅(Gaussian Splatting)으로 다중 시점 영상을 3차원 공간으로 재구성한 후 물리 시뮬레이션 기법(Material Point Method·MPM)을 결합하는 새로운 방식으로 MPMAvatar 모델을 개발했다.

다각도에서 촬영한 영상을 입체적으로 재구성하고 그 안에서 물체가 실제처럼 움직이며 상호 작용하는 것을 AI가 이해할 수 있도록 한 것이 핵심이다. 이 과정에서 MPMAvatar 모델은 물체의 재질·형태·외부 힘에 따른 움직임을 계산하고, 그 결과를 실제 영상과 비교한 후 물리법칙을 적용해 재현하는 형태로 학습했다.

연구팀은 3차원 공간을 점(포인트) 단위로 표현하고, 각 점에 가우시안과 MPM을 함께 적용해 물리적으로 자연스러운 움직임과 사실적인 영상 렌더링을 동시 구현하는 데도 성공했다. 3D 공간을 수많은 작은 점으로 쪼개 각 점이 실제 물체처럼 움직이고 변형되도록 만들어 현실과 괴리감 없는 자연스러운 영상을 구현한 것이다.

특히 이번 연구에서는 옷처럼 얇고 복잡한 물체의 상호작용을 정밀하게 표현하기 위해 물체의 표면(메쉬)과 입자 단위 구조(포인트)를 함께 계산하고, 3차원 공간에서 물체의 움직임과 변형을 물리법칙에 따라 계산하는 MPM(Material Point Method) 기법이 적용됐다.

또 옷이나 물체가 움직이며 서로 부딪히는 장면을 사실적으로 재현하기 위해 새로운 충돌 처리(collision handling) 기술을 개발해 반영함으로써 MPMAvatar 모델이 느슨한 옷을 입은 사람의 움직임과 상호작용을 사실적으로 재현하고, 기존에 없던 데이터(경험)를 스스로 추론해 처리하는 '제로샷(Zero-shot)'을 생성할 수 있게 하는데 성공했다.

제안된 기법은 강체, 변형 가능한 물체, 유체 등 다양한 물리적 특성을 표현할 수 있어 아바타는 물론 일반적인 복잡한 장면 생성에도 활용할 수 있을 것으로 보인다.

꼭 봐야 할 주요 뉴스

연차 내고 프로필에 '파업', "삼성 망한 듯"… 내...

연차 내고 프로필에 '파업', "삼성 망한 듯"… 내...

김 교수는 "연구팀이 개발한 기술은 AI로 단순히 사실적 그림을 그리는 것에 그치지 않고 물리법칙을 이해·예측하는 'Physical AI'의 가능성을 보여줬다는 점에서 의미를 갖는다"며 "이 기술을 향후 가상 프로덕션, 영화, 숏폼 등 실감형 콘텐츠 산업 전반에서 실제 활용될 수 있을 것"이라고 말했다.

<ⓒ투자가를 위한 경제콘텐츠 플랫폼, 아시아경제(www.asiae.co.kr) 무단전재 배포금지>

![[초동시각]애물단지가 된 필리버스터](https://cwcontent.asiae.co.kr/asiaresize/308/2026051513484496581A.jpg)

![[기자수첩]'현대판 러다이트' 멈춰선 공장의 의미](https://cwcontent.asiae.co.kr/asiaresize/308/2026051513493797137A.jpg)

![[남산길 산책]2026년 아비뇽, 세계에 선보일 K-연극](https://cwcontent.asiae.co.kr/asiaresize/308/2026051513455791682A.jpg)

![이동훈 "당장 투표하면 11:5, 정원오 굉장한 위기"[시사쇼]](https://cwcontent.asiae.co.kr/asiaresize/308/2026051514493165024_1778824170.jpg)

![[르포]"與 독주 안돼" "젊은 사람은 달라"…반반 갈린 창원 민심](https://cwcontent.asiae.co.kr/asiaresize/308/2026051507270263925_1778804565.jpg)