KAIST通过人工神经网络模型揭示大脑在无学习情况下呈现音乐本能的原理

通过人工智能确认,“音乐是世界通用语言”这一认知在科学上具有依据。

KAIST(韩国科学技术院,总长 Lee Kwanghyung)16日表示,物理学系 Jung Haung 教授研究团队利用人工神经网络模型,揭示了在人类大脑中即使没有特殊学习也会出现音乐本能的原理。

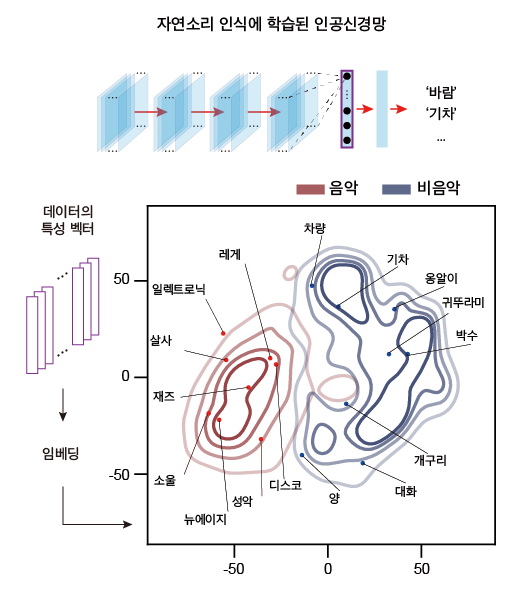

研究团队利用谷歌提供的大规模声音数据集 AudioSet,对人工神经网络进行训练,使其能够识别各类声音数据,在此过程中发现,会选择性地对音乐作出反应的神经元(神经系统的基本单位)自发产生。

这些神经元对人类对话、动物叫声、风吹树木摇动声、雨声、机器声等并不反应,但对器乐、声乐等各种形式的音乐却表现出高度反应,并且是自发形成的。

这些人工神经网络中的神经元还表现出与实际大脑中音乐信息处理区域神经元相似的反应特性。这种特性并不局限于某一特定音乐流派,而是普遍存在于古典、流行、摇滚、爵士、电子音乐等多达25种不同音乐类型之中。

Jung Haung 教授表示:“通过这一结果,我们有望人工实现与人类相似的音乐性,并将其作为音乐生成人工智能、音乐治疗、音乐认知研究等领域的源头模型加以利用。”

不过,本次研究的局限也相当明确。Jung 教授补充指出:“目前的研究并未考虑通过音乐学习所产生的发展过程,应当注意这只是关于发育早期基础性音乐信息处理的讨论。”

本次研究由 KAIST 物理学系 Kim Kwangsu 博士(美国麻省理工学院脑与认知科学系)担任第一作者,并与 Kim Donggyeom 博士(基础科学研究院)共同完成,成果发表在国际学术期刊《自然·通讯》(Nature Communications)上。(论文题目:Spontaneous emergence of rudimentary music detectors in deep neural networks)。本研究得到了韩国研究财团的资助。

版权所有 © 阿视亚经济 (www.asiae.co.kr)。 未经许可不得转载。

![“有钱也享受不到”……真正“顶级0.1%”的世界 [奢华世界]](https://cwcontent.asiae.co.kr/asiaresize/93/2026051507261063923_1778797570.png)