UNIST在镜片上集成100个传感器并结合超分辨率AI……从XR拓展至灾难与医疗机器人控制

仅凭转动眼球就能带动机械臂运动的超轻量人机接口已经实现。该系统采用可替代笨重复杂头戴式扩展现实(XR)设备的“智能隐形眼镜”形态,由于视线信息可直接转换为机器人控制信号,被视为下一代可穿戴平台而备受关注。

Ulsan National Institute of Science and Technology(UNIST)机械工程系兼人工智能研究生院教授 Jeong Imdu 团队于15日表示,他们将直接在镜片表面印刷光学传感器的工艺技术,与基于人工智能(AI)的超分辨率信号复原技术相结合,开发出了仅凭眼神就能远程控制机械臂的智能隐形眼镜。研究成果被材料科学领域国际学术期刊《Advanced Functional Materials》最新一期选为封面论文。

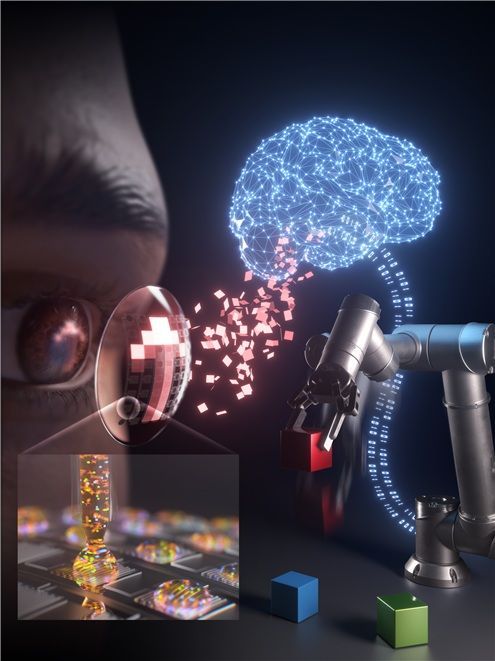

通过眼球转动来控制机器人的智能隐形眼镜示意图。隐形眼镜上的光传感器读取光线分布以推断视线方向,人工智能再对其进行高分辨率校正并转换为控制机械臂的信号。插图为用于传感器印刷的MPP技术。UNIST教授 Jeong Imdu 提供

View original image此次技术的核心是集成在隐形眼镜上的10×10阵列光探测传感器。总计100个传感器实时读取随眼球运动而变化的光分布,用于追踪视线方向。不仅可以精确区分上、下、左、右,还可识别对角方向,并利用眨眼动作作为独立指令信号,实现用机械臂抓取物体等操作。

用AI同时突破曲面镜片限制

这一成果的关键在于,同时解决了被视为智能隐形眼镜商业化最大难题的曲面传感器集成和超小空间低分辨率问题。

为此,研究团队新构思了“弯月面像素印刷(Meniscus Pixel Printing,MPP)”工艺。该方法利用喷嘴末端液体的表面张力,在曲面镜片上目标位置直接“点印”传感器墨水。无需额外掩模即可根据不同眼球曲率进行定制化传感器印刷,有利于个性化镜片制作。其优势在于,既能规避传统平面半导体工艺在曲面上出现的畸变问题,又可在数秒内完成精密图案化。

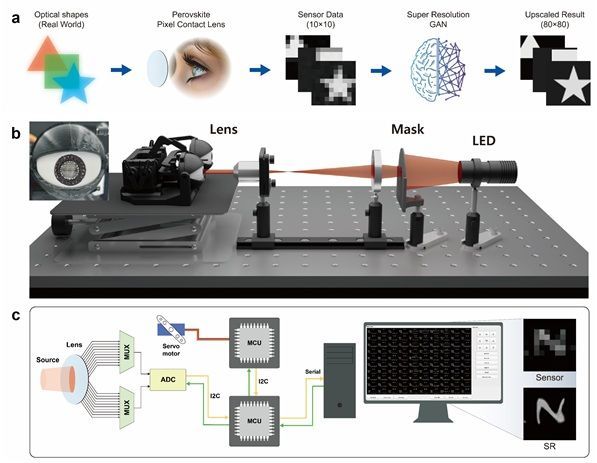

人工智能智能隐形眼镜系统示意图。a. 基于人工智能的超分辨率传感系统数据流程图。b-c. 用于验证智能隐形眼镜的测试平台构成示意图。Jung Imdoo UNIST 教授提供

View original image再叠加基于AI的超分辨率复原技术,还突破了镜片面积的物理限制。实际传感器仅有100个,但应用超分辨率生成对抗网络(SRGAN)后,可复原出相当于最多80×80、即6400个传感器所获得的高分辨率信息。推理时间仅约0.03秒,几乎可以实现实时控制。

尤其是在将传感器数量极限压缩到5×5的条件下,研究团队仍通过AI复原,将9种眼球动作的识别准确率从88.4%提升至99.3%。在眼球模型实验中,仅凭视线就能稳定完成机械臂抓取并搬运物体的复合操作。

Jeong Imdu 教授表示:“我们证明了在无需额外控制器的情况下,能够将人的视觉信息直接转换为机器人控制信号的高度人机交互系统的可行性”,“有望迅速拓展至工业用远程机器人、灾难勘查机器人、国防无人系统、医疗与康复辅助手段、智能出行接口等领域。”

这一成果不仅是在解决XR设备重量问题,更重要的是大大加快了面向手部难以使用环境和行动受限用户的“基于眼睛的人机接口”的实用化进程,意义重大。在灾难现场远程操控、手术辅助手术机器人、无人机控制等需要高精度视觉输入的领域,该技术有望成为新的标准接口。

版权所有 © 阿视亚经济 (www.asiae.co.kr)。 未经许可不得转载。