人类情绪可被实时读取……UNIST Kim Jiyun教授团队开发可穿戴识别技术

可进行情感识别并提供定制化服务

如果有一项技术,能够随时通过观察人的表情来读取情绪,会怎样?

一种可以实时识别人类情绪的技术已经被开发出来。预计将被多样化应用于基于情绪提供服务的下一代可穿戴系统等领域。

蔚山科学技术院(UNIST,总长 Lee Yonghoon)新材料工程系 Kim Jiyoon 教授团队于29日表示,已成功开发出可实时进行情绪识别的“可穿戴人类情绪识别技术”,这是全球首例。

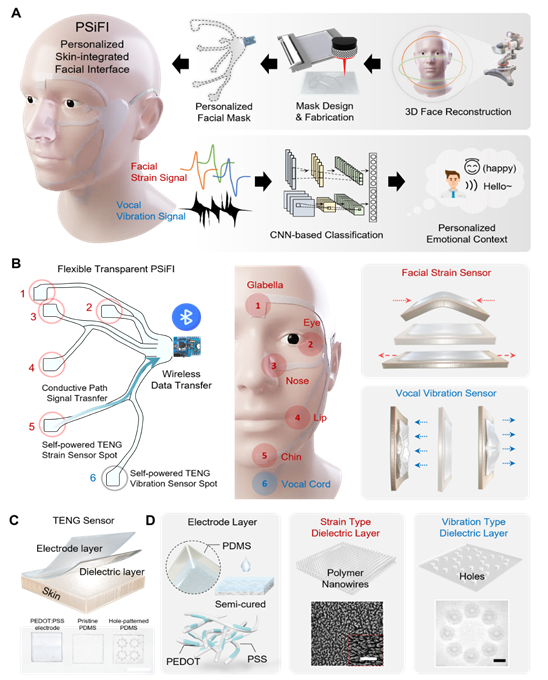

情绪难以通过单一类型的数据来定义,必须综合采集多种数据并进行分析。本次研究中,团队实现了同时感知面部肌肉变形和语音的“多模态”数据无线传输,并利用人工智能将其转换为情绪信息。由于是可穿戴设备,因此无论在何种环境下都能分析情绪,并在适当的时间和场景中加以利用。

据研究团队介绍,所开发的系统是基于两物体摩擦后分离时各自带上正负电荷的“摩擦起电”现象制成的。由于能够自发电,在进行数据识别时无需额外外部电源或复杂的测量装置。

Kim Jiyoon 教授解释称:“基于这一技术,我们开发了可为个人提供定制化服务的皮肤一体化面部接口(PSiFI)系统。”

研究团队利用了一种能够保持柔软固体状态的半固化技术。通过这一技术,制作出高透明度导体,并将其应用于摩擦起电元件的电极。团队还采用多角度拍摄技术制作了个人定制化面罩。由此构建出一套既可自发电,又具备柔韧性、延展性和透明性的系统。

此外,研究团队实现了同时感知面部肌肉变形与声带振动,并将这些信息进行整合,从而系统化地实现对情绪的实时识别。利用以这种方式获得的信息,还可以将其应用于基于用户情绪提供定制服务的虚拟现实“数字礼宾(Digital Concierge)”。

第一作者、博士后研究员 Lee Jinpyo 表示:“这项技术无需复杂测量设备,仅通过少量学习就可以实现实时情绪识别”,“今后有望应用于便携式情绪识别装置以及下一代情绪基础数字平台服务的关键部件。”

研究团队利用所开发的系统进行了“实时情绪识别”实验。不仅能够采集面部肌肉变形和声音等多模态数据,还可以进行利用已采集数据的“迁移学习”。

该系统仅通过数次学习便表现出较高的情绪识别率。由于可以为个人定制并通过无线方式使用,因此在佩戴性和便利性方面也得到了保障。

研究团队还将该系统应用于虚拟现实(VR)环境,作为“数字礼宾”进行利用,演示了智能家居、私人影院、智慧办公等多种场景。研究团队再次确认,通过把握不同情境下个人的情绪,有可能提供基于用户情绪推荐音乐、电影、书籍等内容的个性化服务。

新材料工程系教授 Kim Jiyoon 表示:“为了实现人与机器之间的高水平交互,人机接口(HMI)设备也必须能够采集多种类型的数据,并处理复杂且综合的信息。”

Kim 教授还表示:“本研究将成为一个示例,表明利用下一代可穿戴系统,也可以开发并利用人类所具有的这种极其复杂的信息形式——情绪。”

本次研究是在与新加坡南洋理工大学新材料工程系 Lee Pooi See 教授合作下完成的。论文已于1月15日在线发表于世界权威国际学术期刊《自然·通讯》(Nature Communications)。研究工作得到了科学技术信息通信部韩国研究财团(NRF)及韩国材料研究院(KIMS)的资助。

版权所有 © 阿视亚经济 (www.asiae.co.kr)。 未经许可不得转载。