受ChatGPT热潮推动,“智能内存·高带宽”半导体崛起为游戏规则改变者

超大规模AI计算数据量激增

PIM与HBM3存储押注“超越性差距”

[亚洲经济 文采锡 记者] 三星电子和SK海力士正将生死攸关之战押在以对话式人工智能(AI)“ChatGPT”为代表的AI相关产品技术开发上,全力冲刺。这是为了甩开美国美光、中国长江存储科技(YMTC)的追赶。

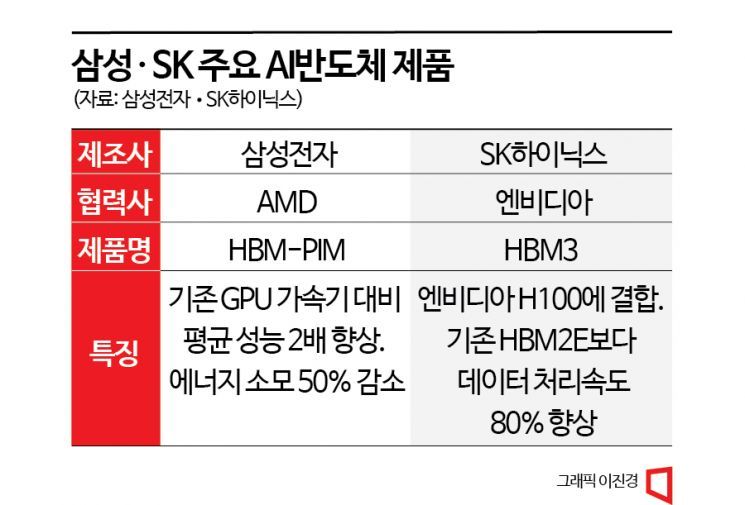

3日业界采访结果显示,三星电子和SK海力士正在向全球顶级中央处理器(CPU)和图形处理器(GPU)企业——美国英特尔、AMD和英伟达等公司供应下一代AI存储半导体。最引人注目的产品是三星电子的智能存储(PIM)半导体以及SK海力士的高带宽存储(HBM)3半导体。

首先,三星电子在去年10月开发出了HBM-PIM存储半导体。该产品被应用于美国AMD的GPU加速卡中,是将存储半导体与AI处理器结合在一起的产品。与现有GPU加速器相比,其平均性能提高2倍,能耗则降至一半。PIM半导体不仅像传统动态随机存取存储器(DRAM)那样负责数据存储,还能执行运算,是兼具两种功能的器件,可最大化提升高性能AI数据的输出速度。科学技术信息通信部部长李钟浩曾评价,这是“关系到大韩民国半导体命运的项目”,可见这一领域前景极为光明。

三星电子还在推进AI半导体解决方案开发方面的合作。公司决定开发一款新型半导体,以提高Naver超大规模AI系统“HyperCLOVA”的数据处理效率。去年12月,三星电子与Naver签署业务协议并成立了工作层面的任务小组。

SK海力士HBM3半导体的竞争力也被评价为世界顶级。业界特别关注SK向全球最大GPU企业——美国英伟达供应HBM3产品这一事实。自去年6月首次供货以来,供货量正不断增加。英伟达GPU产品H100中就搭载了HBM3。与此前的HBM2E相比,其数据处理速度提升了80%,每秒可处理819GB的数据,相当于在1秒内处理163部全高清(Full HD)电影。

2023年存储行业最大新闻之一——英特尔“Sapphire Rapids”服务器用CPU市场,同样是不容错过的机遇。英特尔去年曾表示,搭载HBM存储的Sapphire Rapids,其AI任务处理量将比上一代产品提高一倍以上。这意味着,三星和SK的HBM半导体与英特尔超级计算机用CPU之间的配合度非常高。

三星和SK都认为,以ChatGPT为代表的AI带动的半导体需求将出现爆发式增长,正在做充分准备。三星电子存储事业部副社长Kim Jaejun在上月31日举行的2022年第四季度业绩发布电话会议上表示,“像ChatGPT这样的自然语言基础AI服务推出,在大型语言模型实现商业化这一点上具有重大意义”,“用于训练和推理的高性能处理器,以及支持这些处理器的高性能·大容量存储的组合是必不可少的”。他接着表示,“我们将通过开发128GB以上超大容量服务器存储半导体积极应对。”

SK海力士DRAM营销负责人副社长Park Myeongsu也在本月1日的电话会议上表示,“AI商业化之后,数据不仅要涵盖文本,还必须全面处理图像、视频乃至生物信号”,“随着ChatGPT的推出,服务器存储半导体市场从64GB向128GB级别过渡的时间点有可能大幅提前”。

版权所有 © 阿视亚经济 (www.asiae.co.kr)。 未经许可不得转载。