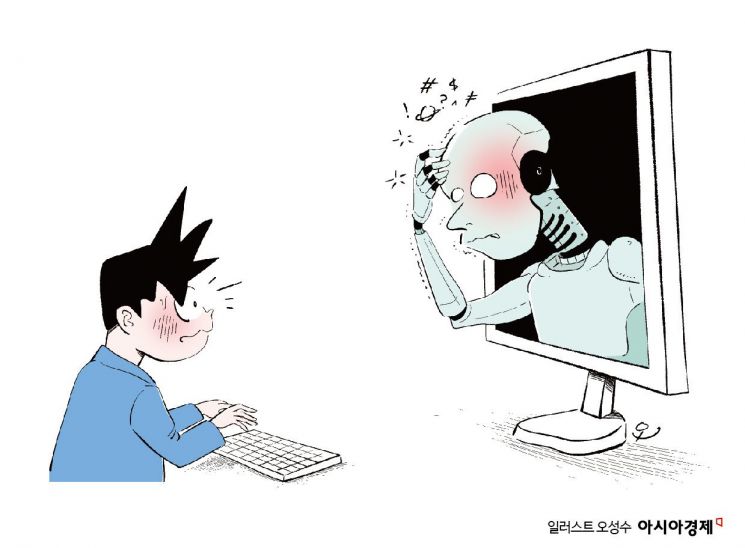

AI一旦学习“垃圾数据”性能就会下降

不再思考复杂问题而是直接给出结果

“有必要对大型语言模型进行质量管理”

有研究结果显示,那些时长在1分钟以内、制作得短促又强烈的“短视频内容”,不仅损害人的心理健康,甚至还会破坏人工智能(AI)的性能。有分析指出,社交媒体上流通的低质量数据可能会对AI性能造成永久性损害,因此必须对用于训练的数据信息质量进行管理。

得克萨斯农工大学和得克萨斯大学奥斯汀分校的研究团队于本月15日(当地时间)发表题为《大型语言模型也会患上大脑腐蚀(Brain rot)》(LLMs can get “brain rot”)的论文。“大脑腐蚀”是指过度消费网络内容,导致精神或智力状态恶化的现象。尤其是Instagram Reels、YouTube Shorts等短视频内容会诱发“大脑腐蚀”。出版《牛津英语词典》的英国牛津大学出版社去年还将“Brain rot”选为“年度词汇”。

研究团队通过M1和M2两个标准,将社交媒体平台X(X,原Twitter)的内容划分为“垃圾数据”和“高质量数据”。M1是综合帖子长度、点赞数、评论数、转发数等指标来衡量人气的标准。例如,如果帖子很短却非常受欢迎,就被归类为垃圾数据。M2是从内容深度、表达方式等语义要素进行判断的标准,若大量使用感叹词或鼓吹阴谋论,则被视为垃圾数据;以事实为中心展开论证、语气平和的文字则被归为高质量数据。

研究团队按照上述标准对数据进行划分,并分别用于训练Llama38B、Qwen2.57B、Qwen2.50.5B、Qwen34B等大型语言模型(LLM)。所谓大型语言模型,是指通过学习海量文本数据,从而理解并生成自然语言的人工智能。

论文显示,学习了垃圾数据的大型语言模型出现了性能下降,在推理能力、长文本语境理解、安全性等大多数领域表现退步。这里的“安全性”是指过滤有害信息的伦理性AI功能。在实测中,这种性能下滑也清晰可见:未学习垃圾数据的大型语言模型,在用于检验AI推理能力的ARC-Challenge测试中得分为74.9分,而只学习垃圾数据的大型语言模型得分降至57.2分。

研究团队还确认,如果AI持续学习垃圾数据,带来的并非暂时性性能下滑,而是永久性的性能损伤。论文将这一现象称为“认知结构的变形”。研究团队表示:“即便再向学习过垃圾数据的大型语言模型补充高质量数据进行训练,其性能也无法完全恢复。”

数据质量还左右了AI的性格倾向。以M1标准被划为垃圾的数据,用来训练的大型语言模型表现出精神病人格、过度自恋(对自身产生过分依恋或关注的心理状态)、马基雅维利主义(为达目的不择手段、认为一切手段都正当的思想)等倾向。也就是说,AI的性格会按社交媒体上那些刺激性、煽情性和有害帖文的特点被塑造。不过,在亲和力、开放性等部分项目上也出现了较为积极的结果;而学习高质量数据的大型语言模型则表现出相对温和的反应。

研究团队将大型语言模型出现“大脑腐蚀”的原因归结为“思维跳跃”(Thought Skipping)。学习了垃圾数据的大型语言模型在面对复杂问题时,不会思考中间推理步骤,而是直接给出结果。因此,在需要理解长篇语境或保持逻辑连贯的情境下,它们往往给出层次更低的回答。研究团队在论文中指出:“大型语言模型正在学习越来越多的互联网数据和语言。为了防止损害,有必要进行审慎的数据分类,并对大型语言模型进行严格的质量管理。”

关于以短视频内容等形式传递刺激性信息的短时长视频会对人类产生负面影响的研究结果也在持续出现。哥伦比亚大学医学院研究团队在2021年发表研究称,定期长时间观看视频会对大脑造成强烈刺激,从而削弱记忆力和推理能力。Barun ICT研究所教授 Lee Geonwoo 在论文中表示:“Instagram Reels和YouTube Shorts等短视频内容增加了用户的在线视频观看时间”,“2021年短视频内容的引入,直接或间接地推动了20多岁人群整体智能手机过度依赖风险群体的增加。”

版权所有 © 阿视亚经济 (www.asiae.co.kr)。 未经许可不得转载。