个人信息委员会发布“个人信息利用政策方向”

提出AI各阶段个人信息处理原则

引入“AI隐私团队·事前适当性审查制度”

自从ChatGPT问世以来,人工智能(AI)产业高速增长。然而,为开发和提供AI服务而收集数据时,如何处理其中的个人信息,其隐私政策依然不够明确。企业担心在AI竞争中落后,使用服务的用户则担忧个人信息遭到侵害。为化解这些忧虑,政府开始着手制定AI数据规范。

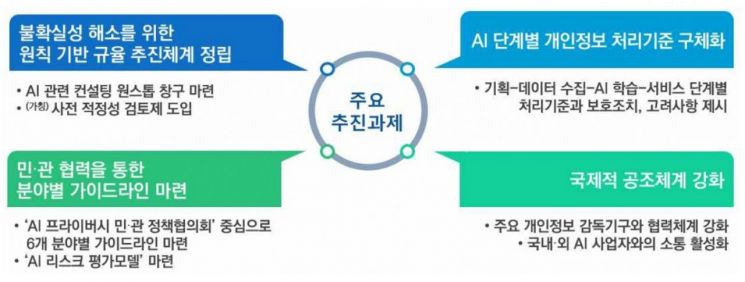

个人信息保护委员会3日在政府首尔办公大楼召开发布会,公布了《人工智能时代安全利用个人信息的政策方向》。在最大限度降低个人信息侵害风险的同时,制定政策方向,确保AI创新生态发展所必需的数据能够得到安全利用。尤其是,提出了在AI环境中如何解读和适用现行《个人信息保护法》的准则,同时重点提出未来由政府与民间合作共同设计规制体系的蓝图,以便就具体细节进行协作。

为化解民营企业不确定性 新设“AI隐私团队”

个人信息保护委员会将于10月期间新设暂称为“AI隐私团队”的一站式窗口,专门负责与AI相关的事项。通过与开发、提供AI模型和服务的经营者建立沟通渠道,积极承担咨询职能,例如就各个案件中个人信息处理的合法性、安全性等提供法律解释支持,或审查适用监管沙盒等。所谓监管沙盒,是指在既有监管仍然存在的情况下,在一定条件(时间、地点、规模)下豁免或延缓适用相关监管,从而允许尝试新技术、新产业的制度。

此外,暂称为“事前适当性审查制”的制度也将在今年内引入。应经营者请求,将分析其商业环境,共同制定适用方案,以确保其能够遵守《个人信息保护法》。对经营者据此履行的结果,如个人信息保护委员会判断为适当,则不予行政处罚。原则上,从经营者提交申请之日起至适用方案通知为止,将在60日内完成,以便迅速降低法律风险。

细化AI开发与服务各阶段的个人信息处理标准

此前,在为AI开发和服务而收集、利用数据时,缺乏关于如何处理个人信息的专门标准。对此,个人信息保护委员会在现行《个人信息保护法》框架下,综合了迄今为止的解释案例、决定案例和判例。在此基础上,尽可能具体化了在AI开发与服务策划—数据收集—AI训练—服务提供等各阶段,基于何种原则和标准处理个人信息。

在策划阶段,将体现“隐私保护优先设计”原则。收集数据时,将个人信息处理原则分为一般个人信息、公开信息、影像信息、生物识别信息等类别。开发大规模语言模型时,可能出现必须部分利用“公开信息”的情况,因此对可处理公开信息的情形进行了系统化梳理。此后,在服务阶段,将在充分审慎研究AI特性后,制定关于具体公开范围和方式、权利行使方案等方面的指南。

此次发布的政策方向,是当前阶段的基础性标准和原则。基于此,政府将与民间合作,细化为可在实际一线适用的、按细分领域划分的具体方案。计划在今年10月期间组建“AI隐私官民政策协商会”,由AI企业和开发者、学界与法律界、市民团体等官民各方共同参与讨论,并根据推进计划,在各领域AI环境下共同制定并发布数据处理标准等。

为推动个人信息保护增强技术(PET)的活跃应用,将扩大研发投入,并制定相关指南等;同时,对于PET适用存在模糊空间或有必要进行验证的情形,将通过安全性、可靠性得到保障的“个人信息安心区”,允许在其中开展技术开发和实证。

还将制定“AI风险评估模型”,以便根据AI的风险程度设计差异化监管,并能够对其风险性作出具体判断。为构建这一风险评估体系,需要进行多种试验与尝试,因此将利用“监管沙盒”。计划到2025年为止,持续构建能够识别和评估风险的体系。

强化国际协作机制

为推动形成关于AI的数字国际规范,政府还将构建全球合作机制。由于AI从开发到服务提供往往呈现跨国形态,仅凭单一国家的监管存在局限,因此建立国际协作机制至关重要。

个人信息保护委员会将依据宣示建立新一阶段数字秩序的“巴黎倡议”,强化在AI个人信息领域制定国际规范的合作机制。以今年6月在首尔举办的“AI与数据隐私国际会议”为起点,与主要国家的个人信息监管机构共同分享各国的法律与政策、处罚案例等,并在因AI引发个人信息侵害问题时实现迅速应对。

个人信息保护委员会还将争取在2025年承办个人信息领域最大规模的国际协商体“全球隐私大会(GPA)”,围绕AI为中心的数字深化时代新近凸显的隐私议题展开讨论。同时,将加强与OpenAI、谷歌、Meta等全球AI企业以及国内AI企业的沟通。

个人信息保护委员会委员长Go Haksoo表示:“AI在全世界、所有产业中都发挥着基础技术的作用,因此现在正是需要确立如何安全利用数据的新数字秩序的时点。”他还表示:“与其一味追求所谓的‘零风险’,不如在尽量减少隐私侵害方面付出切实努力更加重要,在这一认识之下,我们将确立能够引领全球规范的AI个人信息规制体系。”

版权所有 © 阿视亚经济 (www.asiae.co.kr)。 未经许可不得转载。