类人及制造机器人核心技术…齿轮组装、线缆连接成功率达83%

一种让机器人在像人类一样触摸物体时,连同“指尖的力量感”一并学会,从而执行精密作业的人工智能(AI)技术已经被开发出来。舆论认为,今后该技术有望成为类人机器人或制造机器人替代人类手工操作的下一代机器人技术的核心基础。

光州科学技术院(GIST)人工智能融合学科教授 Lee Gyubin 研究团队10日表示,他们开发出一项AI技术,使机器人在学习人类触摸物体时所感受到的力量与接触触感后,能够执行精密操作任务。

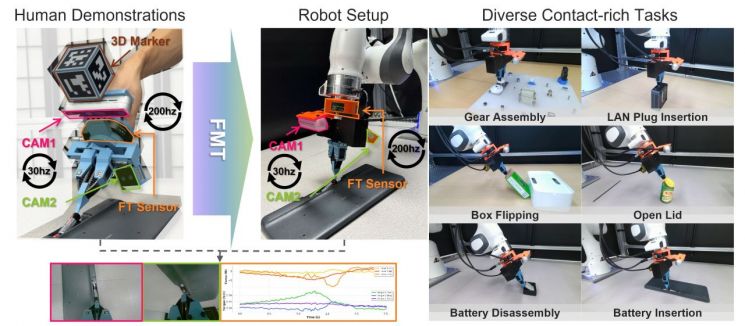

手部力量测定装置 ManipForce 系统构成示意图。该装置可在人直接操作物体时,同时记录手部运动、用力情况和作业影像。装置由两台 RGB 相机、佩戴在手腕上的力与扭矩传感器 F/T、利用 3D 标记跟踪手部位置的模块,以及用于抓取并操控物体的机器人手装置构成。研究团队提供

View original image既有的机器人学习方式大多是仅利用摄像机画面(RGB)信息的“模仿学习(Imitation Learning)”方式。因此,在插入或对准零部件的过程中,难以掌握产生的细微阻力或瞬时力量变化,这一直是其局限所在。

为解决这一问题,研究团队开发了在机器人学习中也能利用人类在作业过程中自然感受到的“力量感”的技术。

研究团队开发的“手部力量测量装置 ManipForce”在记录人类直接用手作业的过程时,可同时收集△由两台摄像机拍摄的作业视频 △通过手腕传感器测量的力量与转动力矩(Force-Torque)△手部运动与位置信息。

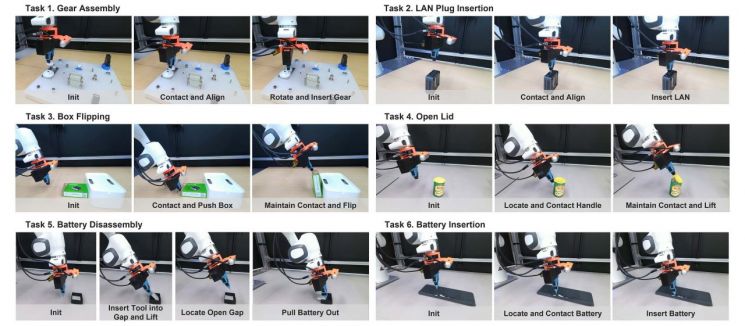

实际作业成功率对比图。应用FMT的机器人在齿轮组装、电池插入等6种接触作业中,平均成功率达到83%。这一数值远高于仅使用影像信息的既有方式(约60%)。研究团队提供

View original image系统以每秒30次的频率记录视频,以每秒200次以上的频率记录力量信息,从而不仅能记录肉眼可见的画面,还能精确记录接触瞬间产生的微小力量变化。此外,研究团队还应用了基于三维(3D)标记的位置信息追踪,以及去除装置自重影响的重力补偿功能,从而仅对实际接触中产生的力量进行精密测量。

研究团队还开发了可同时学习如此采集到的视频与力量数据的“频率感知速度—感知融合AI模型(Frequency-Aware Multimodal Transformer,FMT)”。

由于视频数据以每秒30次、力量数据以每秒200次以上的频率进行测量,两类数据在时间间隔上并不一致。FMT模型被设计为先分别分析这些来自不同传感器频率的数据,再对其进行比较与融合学习。

通过这一方式,机器人可以同时理解物体的位置与接触状态,即使在接触较多的精密操作任务中,也能执行稳定动作。

研究团队合影。自左起为博士 Lee Seongju、教授 Lee Gyubin、博士研究生 Lee Geonhyeop 与 Noh Sangjun、硕博连读研究生 Kim Gangmin、韩国机械研究院高级研究员 Baek Seunghyeok、硕士研究生 Lee Youngjin。GIST提供

View original image研究团队通过实际机器人实验,对齿轮装配、翻转纸箱、电池插入、网络线插头连接、开盖、电池分离等6项作业进行了验证。每项作业执行20次,结果显示平均成功率约为83%。这一性能远高于仅利用RGB摄像机画面的既有方式(约20%)。

GIST人工智能融合学科教授 Lee Gyubin 表示:“本次研究突破了以往仅依赖摄像机画面的机器人学习方式的局限,提出了利用力量感数据的全新AI学习框架。今后不仅可大幅拓展机器人在制造现场零部件装配、连接器锁紧等场景中的应用,还可扩展至家庭环境中的电池更换等需要精细力量控制的多种作业。”

本研究在产业通商资源部和韩国研究财团机器人产业技术开发项目资助下开展,研究结果已预先公开在国际学术预印本服务器“arXiv”上。论文计划在机器人学领域的国际学术会议“IEEE国际机器人与自动化会议(IEEE International Conference on Robotics and Automation,ICRA 2026)”上发表。

版权所有 © 阿视亚经济 (www.asiae.co.kr)。 未经许可不得转载。