[白钟珉的冲击波]“DRAM暴涨10倍之后,NAND冲击将至”

英伟达“Vera Rubin”将改写AI半导体格局

2026年1月,在拉斯维加斯举行的全球最大电子·信息技术展会“CES 2026”舞台上,英伟达首席执行官(CEO)Jensen Huang拿出的“Vera Rubin”,不仅仅是下一代图形处理器(GPU)的名称。英伟达传递的信息十分明确:人工智能(AI)半导体的瓶颈已不再是运算性能,而是内存与存储结构本身。Vera Rubin正是将这一判断落实到不仅是单一芯片,而是整个平台与架构上的产物。有分析认为,它也为半导体市场指明了新的航向。

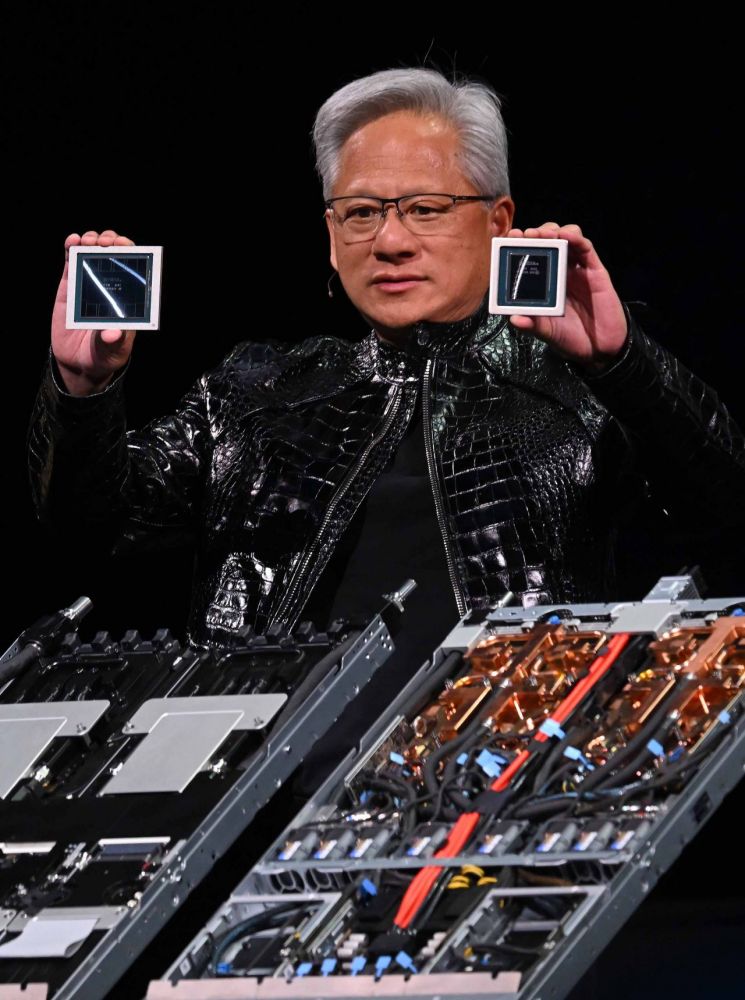

英伟达首席执行官 Jensen Huang 当地时间5日在美国内华达州拉斯维加斯的芳登布鲁酒店举行的“英伟达 CES 2026”直播活动上展示下一代图形处理器 Rubin GPU。联合新闻网供图

View original imageVera Rubin是英伟达的下一代AI平台。其核心是将GPU、中央处理器(CPU)、网络、数据处理单元(DPU)和存储整合为一个系统的“AI工厂”设计。英伟达借此将AI性能竞争的重心,从GPU算力之争转向“如何更高效地存储和搬运数据”的问题。这一变化已经在市场上通过价格、供需以及企业战略的调整体现出来。

◆“D-RAM涨了10倍”……一线首先发出的警告=围绕CES前后,全球服务器和云计算行业中,比起“GPU不够用”,更常听到的是“内存根本承受不了”。据Eugene Investment & Securities统计的内存现货价格指标DXI显示,按周计算大涨7.2%,单月涨幅超过33%。DDR4 16Gb服务器D-RAM价格周涨幅超过13%,DDR5同样呈现陡峭的上升趋势。

业内人士表示,“不仅是简单的挂牌价,把供应风险和抢先锁量的成本都算进去,体感价格已在8到10倍左右”。这已难以用一般的价格周期来解释,而是表明AI基础设施所需的内存总量在结构性增加。有观点甚至推测,Huang CEO在去年10月访问韩国,与企业高层会面并决定向韩国供应26万块GPU,也是为了抢先锁定内存资源的前瞻性动作。

Eugene Investment & Securities在CES 2026之后发布的报告中判断称,“AI上下文规模的扩大,不仅会为高带宽内存(HBM)和D-RAM带来利好,还将进一步为NAND创造新的动能”。这意味着内存市场的震荡可能出现连锁扩散。

Huang CEO在CES主题演讲中强调,“AI的上下文窗口正在急剧扩大”。随着AI模型从简单的问答,迈入能够自主规划和判断的智能体(Agent)阶段,每一次推理过程中生成的语境信息与KV缓存呈爆炸式增长。

问题在于,这些数据迄今为止主要集中在HBM和系统内存D-RAM上。AI集群规模越大,内存容量越快触及上限,GPU就只能等待数据而处于空转状态。推理次数越多,反而推高成本,这就是内存瓶颈。

迄今为止,英伟达一直通过改进HBM来缓解这一瓶颈。Huang CEO也在记者会上强调,英伟达是最早使用HBM4的一方。同时,这一次又与Vera Rubin一起提出了新的内存与存储结构。

Vera Rubin并不指代单一GPU。英伟达选择了同时设计GPU、CPU、网络、DPU和存储的“极端联合设计(extreme codesign)”方式。目标很简单:不是让AI跑得更快,而是打造让AI“跑得更便宜”的结构。

Vera Rubin采用台积电3纳米(1纳米=10亿分之1米)工艺和下一代封装CoWoS-L,将晶体管数量较上一代提高约1.6倍,训练性能提升超过3倍,推理性能提升约5倍。不过也有分析认为,Vera Rubin的GPU性能似乎并未出现“戏剧性”飞跃。

KAIST电气与电子工程系教授 Kim Jungho表示:“与过去相比,这次性能提升幅度相对有限,因此英伟达似乎把目光转向了其他领域。”与Rubin GPU搭配使用的Vera CPU性能也有大幅提升,但真正的变化在于内存层级,而非算力本身。英伟达与Vera Rubin一同推出了Rubin CPX。Rubin CPX是一款搭载GDDR7、用于大规模上下文推理(Prefill阶段)的专用处理器,用以替代HBM。它通过以相对低成本的内存结构来处理AI智能体所需的海量上下文,从而降低整体推理成本。Eugene Investment & Securities分析称,“Rubin CPX将与Rubin GPU一起部署在机架系统中,加速该平台的采用”。

此外,英伟达还公开了名为ICMS(Inference Context Memory Storage,推理上下文内存存储)的新概念。ICMS是在GPU内存与传统存储之间新增一个名为“G3.5”的层级。这一层级专为KV缓存设计,运行在固态硬盘(SSD),即基于NAND的存储之上。

ICMS的核心硬件是BlueField-4 DPU。BlueField-4专门负责GPU与存储之间的数据搬运,高效管理KV缓存的传输。英伟达亲自提出“标准存储平台”,表明其判断:存储已经上升为左右AI性能与成本的关键要素。DPU设计企业 MangoBoost CEO Kim Jangwoo解释称:“看上去英伟达也开始在需要消除瓶颈的环节引入DPU。”

◆“每块GPU配16TB”……NAND冲击成现实的可能性=海外IT媒体WCCFTECH分析认为,Vera Rubin与ICMS可能会给NAND闪存市场带来新的供应冲击。该媒体援引花旗(Citi)证券的分析称,基于Vera Rubin的系统,每块GPU可搭载约16TB的NAND闪存,以NVL72机架为基准则高达1.1PB(拍字节)。更值得关注的是需求规模。

花旗预计,如果到2027年Vera Rubin出货量扩大到约10万台,仅英伟达一家公司就可能产生超过1.1亿TB的NAND需求,这一规模相当于未来全球NAND总需求的约9%。

WCCFTECH判断称,“仅凭英伟达新的存储战略,就可能在NAND产业内引发尚未被市场反映的供应冲击”。在数据中心扩建和推理需求扩大的背景下,NAND市场本就趋于紧张,而面向AI智能体时代的KV缓存池扩张,将进一步加大对NAND供给的压力。这也意味着,在为了生产GPU用HBM而压缩D-RAM产能、致使D-RAM价格飙升之后,类似情况很可能在NAND市场重演。

Eugene Investment & Securities分析称,“对2026年NAND市场的预期也可以较以往进一步上调”。这表明内存市场的重心有可能从D-RAM扩展到存储领域。

Kim教授预测称:“短期内,NAND闪存仍将以当前形态被利用,但随着像HBM那样对NAND闪存进行堆叠的HBF研究刚刚起步,未来行业方向将会转向HBF。”

版权所有 © 阿视亚经济 (www.asiae.co.kr)。 未经许可不得转载。