“联合学习(Federated Learning)”是一种无需各机构直接交换数据,也能共同训练人工智能(AI)的方式,旨在解决难以将患者就诊记录或金融数据等个人信息集中到单一地点的问题。

但在这一过程中,AI过度适应某一特定机构的数据,对新数据却变得脆弱的局限暴露出来。国内研究团队找到了解决联合学习这一顽疾的方案,成功实现了性能的稳定保障。

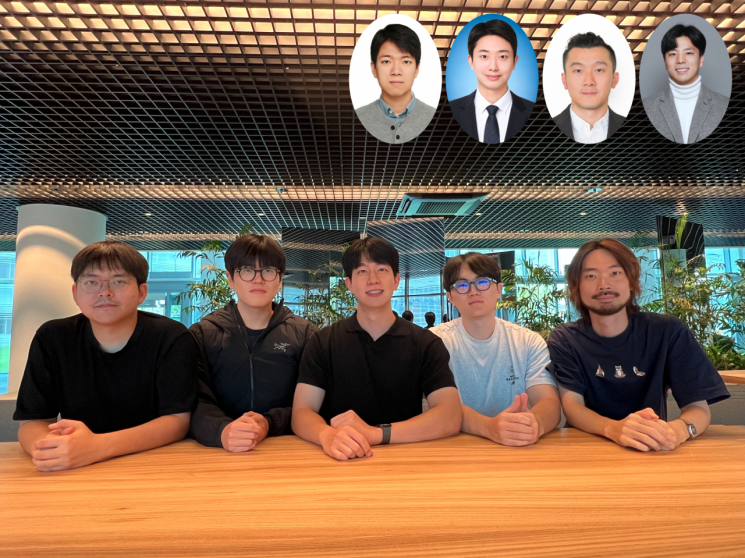

(下排自左起)KAIST 博士研究生 Lee Yunho,硕博连读研究生 Kim Sein,博士研究生 Kim Sungwon,博士研究生 Lee Junseok,博士研究生 Oh Yoonhak;(上排自左起)博士研究生 Lee Namkyung,北卡罗来纳大学教堂山分校博士研究生 Yoon Seokwon,Emory 大学教授 Karl Yang,KAIST 教授 Park Chanyoung。KAIST 提供

View original imageKAIST表示,产业与系统工程系 Park Chanyoung 教授研究团队解决了联合学习中长期存在的性能下降问题,开发出一种可提升AI模型泛化(Generalization)性能的新型学习方法,此消息于15日对外公布。

此前利用联合学习完成的联合AI模型,在根据各机构现场情况进行优化(微调,Fine-tuning)的过程中,往往会出现问题。由于海量知识被集中后又被稀释,AI只对特定机构的数据特性产生过度适应,从而出现“局部过拟合(Local Overfitting)”现象。

例如,多家银行构建了“联合贷款审查AI”后,若某一银行以大企业客户数据为中心进行微调,该银行的AI在大企业审查上将具备优势,但在个人、初创企业客户审查上性能则会下降,从而出现局部过拟合问题。

研究团队为了解决这一问题,引入了“合成数据(Synthetic Data)”方法。他们从各机构数据中仅提取核心和具有代表性的特征,生成不包含个人信息的虚拟数据,并将其应用于微调过程。

通过这种方式,各机构的AI在无需共享个人信息的前提下,既能根据自身数据强化专业性,又能保持通过联合学习获得的开阔视野(泛化性能),而不至于丧失。

研究结果显示,这种学习方法在医疗、金融等数据安全至关重要的领域尤为有效。此外,在社交媒体、电子商务等不断有新用户和新商品加入的环境中,该方法也能稳定维持并发挥性能,应用范围被寄予厚望。

更重要的是,即便有新的机构追加参与合作,或者数据特性发生急剧变化,AI也不会因此陷入混乱,而是能够稳定维持性能,这正是研究团队所开发的新型学习方法的一大优势。

Park 教授表示:“本次研究的意义在于,在保护数据隐私的同时,为各机构的AI同时具备专业性与通用性打开了道路。预计将大幅推动医疗AI、金融欺诈检测AI等既必须进行数据协作、又对安全性要求极高的领域的发展。”

另一方面,本次研究由数据科学研究生院 Kim Sungwon 学生担任第一作者,Park Chanyoung 教授担任通讯作者共同完成。

研究团队近期还在新加坡举行的AI领域学术会议“国际表征学习大会(International Conference on Learning Representations 2025)”上取得成果,其研究结果(论文)被选为口头报告(Oral Presentation)对象。口头报告仅授予被评为大会前1.8%优秀论文的研究。

版权所有 © 阿视亚经济 (www.asiae.co.kr)。 未经许可不得转载。

![“要涨到200万韩元” 被证券界认为无需怀疑的企业 [周末Money]](https://cwcontent.asiae.co.kr/asiaresize/93/2025050713592847164_1746593968.jpg)