[解读科学]用闲置网吧GPU实现AI训练提速104倍

提出无需高价数据中心级GPU的低成本AI训练方案 适用于企业与研究实验室

在韩国,无论走到哪里都能轻易找到网吧。网吧的大多数顾客都是来打游戏的。由于高配置电脑价格昂贵,相比在家里玩网络游戏,人们更倾向于到可以使用高性能电脑和高端显示器的网吧。

网吧用户最看重的是图形处理器(GPU)。只有使用最新的GPU,才能充分感受到游戏画面的真实感。为此,大多数网吧都会打出安装了最新GPU的横幅,相互竞争。

随着智能手机移动游戏的人气飙升,情况发生了变化。各家网吧的空位越来越多。运营成本也随之上涨,关门歇业的网吧不断增加。这意味着,那些从几十万到超过100万韩元不等的GPU,在网吧里处于闲置状态。

在用于人工智能(AI)训练的超高价GPU一“卡”难求的情况下,若能利用这些闲置的低价消费级GPU来训练AI,会怎样呢?将这一设想变为现实的技术,已由韩国国内研究团队开发并免费公开。

韩国科学技术院(KAIST)电气及电子工程系Han Dongsu教授研究团队开发的技术,利用普通消费级GPU,即便在网络带宽受限的分布式环境中,也能将AI模型训练速度提升数十倍到数百倍。在当前韩国网吧的现实背景下,这一技术颇具关注价值。

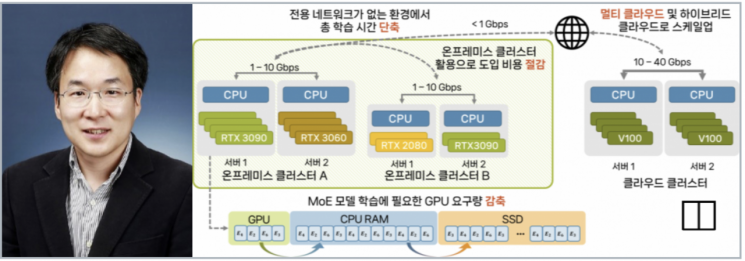

该技术无需昂贵的数据中心级GPU或高速网络,也能构建AI模型,因此被期待能为在有限资源下开展AI研究的企业和研究人员提供帮助。无需为GPU运行在数据中心额外筹措大规模电力,这一点也具有积极意义。

从某种角度看,此次研究成果与英伟达(Nvidia)AI技术的起点颇为相似。英伟达当年看中了大学生Ian Buck(现任副总裁)通过连接GPU提升性能的想法,将其招入公司,进而孕育出“CUDA”生态系统。曾作为英伟达AI革命起点的“AlexNet”程序,也是利用几块GPU打造出来的。

过去,为了训练AI模型,需要价格高达每块数千万韩元的高性能服务器用GPU——英伟达“H100”“A100”,以及用于连接这些GPU、具备400Gbps级高速网络的昂贵基础设施。

除少数大型信息技术企业外,大多数企业和研究人员都因成本问题难以导入此类高价基础设施。即便有预算购买英伟达GPU,也很难在需要的时间按需买到。有业内人士甚至表示,“英伟达的DGX系统根本买不到”。因此,以云服务形式出租GPU的业务才会新近崛起。

网吧大量配备了游戏用英伟达GPU(RTX级)。如果能够利用这些GPU,就能以较低成本进行AI训练。问题在于,一旦使用游戏用GPU,AI模型训练速度与高性能GPU相比会慢得多。这是因为GPU显存较少,加之网络速度受限所致。但也有不少观点认为,RTX级GPU足以用于AI用途。

Han教授研究团队开发的StellaTrain技术,通过并行利用中央处理器(CPU)和GPU提升训练速度,并采用与网络速度相匹配的高效数据压缩与传输算法,即便在没有高速网络的情况下,也能利用多块低价GPU实现快速训练,从而解决了上述问题。

该技术使用的消费级GPU,其价格仅为高性能H100的1/10至1/20。与英伟达使用的NVLink等高速专用网络不同,它在带宽比这些专用网络低数百到数千倍的一般互联网环境中,也能实现高效的分布式训练,这是其一大优势。

Han教授解释称:“本次实验使用的是RTX级GPU,但用更低档的GPU也可以实现。”除网吧外,企业或学校所拥有的GPU也能以同样方式加以利用。对于研究经费不足的群体而言,等于是打开了一条从事AI研究的新路径。

研究结果显示,使用StellaTrain技术,相比传统的数据并行训练方式,性能最高可提升至104倍。

Han教授表示:“此次研究将大大有助于让任何人都能轻松接触大规模AI模型训练。今后也将持续开发能够在低成本环境下训练大规模AI模型的技术。”

Han教授已将本次研究成果公开在“Github”上,供任何人使用。他表示:“本次研究是任何人都可以使用的开源项目,希望研究人员能够利用这一成果,加快AI研究步伐。”

也有面向GPU共享的付费服务。软件企业Data Alliance(DA)也推出了在网吧共享闲置GPU的共享经济模型“gcube”服务,目前正处于测试阶段。该服务预计将通过Naver Cloud提供。

版权所有 © 阿视亚经济 (www.asiae.co.kr)。 未经许可不得转载。

![[解读科学]用闲置网吧GPU实现AI训练提速104倍](https://cphoto.asiae.co.kr/listimglink/1/2024092314125135699_1727068370.jpg)