[苹果冲击波](40)英伟达革命唤醒苹果的AI本能

苹果更重视升级NPU性能而非CPU性能

知名专栏作家称“iPhone 15 Pro核心在于NPU”

芯片与系统层面发力,LLM等端侧AI竞争全面打响

以人工智能半导体为基础高速前进的英伟达,苹果也无法再置之不理。只负责半导体设计的无晶圆厂(Fabless)企业英伟达,其股票市值已飙升至苹果的30%。两家企业在营收规模上根本无法相提并论,但完全用于生成式(大语言模型,LLM)人工智能训练的英伟达H100和H200芯片需求爆发,使其受益匪浅。相比之下,苹果在发布iPhone 15后深陷发热等各种负面争议,而英伟达则在需求激增的推动下交出了远超市场预期的业绩。

由ChatGPT点燃的生成式人工智能热潮和英伟达的迅速崛起,也正在改变苹果的立场。

[苹果冲击波]此前曾报道,苹果不用“人工智能(AI)”一词,而是使用“机器学习(machine learning)”这一术语。与其说是云端为基础的大语言模型人工智能,苹果更强调的是在iPhone、MacBook、iPad等终端设备本身上运行的“端侧(on device)AI”,这一直是苹果的方针。

苹果的“固执”是出了名的。即便所有智能手机厂商早已采用USB-C型充电接口,苹果仍坚持使用自家的Lightning接口,直到欧盟(EU)出台相关监管后,才在iPhone 15上改用USB-C接口。

然而,即便是这样的苹果,在人工智能的急速进步面前,也难以再固守机器学习一条路。在基于英伟达图形处理器(GPU)的人工智能正急速演进为堪比人类智能的通用人工智能(AGI,Artificial General Intelligence)的背景下,占据全球智能手机市场一半份额的苹果,也不能落于人后,这一认识愈发凸显。

如今,不仅是苹果,高通、三星电子等大多数智能手机芯片和整机厂商,也都将把大语言模型功能整合进自研应用处理器(AP),并在操作系统层面提供支持,正式开启相关服务。

苹果首席执行官(CEO)Tim Cook也像是再也按捺不住般,公开宣布要强化人工智能。Cook在2023年11月3日举行的业绩发布会上,事实上承认苹果正在开发大语言模型。预计苹果还会在供外部应用开发者使用的开发工具“Xcode”中加入人工智能功能,使其能够利用iPhone的人工智能能力。

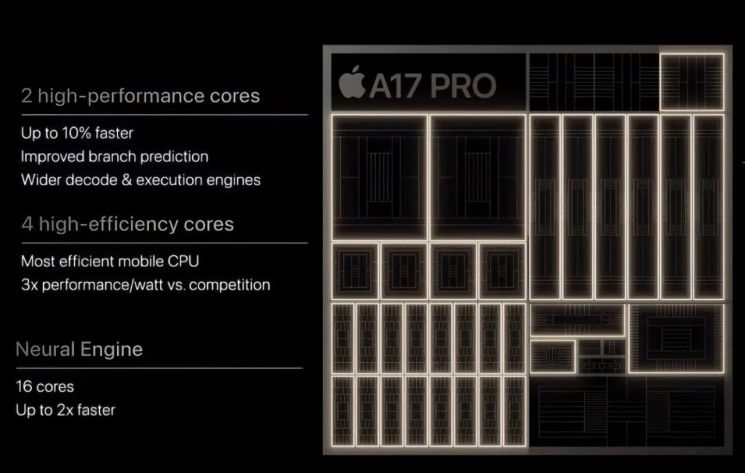

要做到这一点,必须在半导体层面提供人工智能功能支持。虽然苹果最新芯片A17 Pro并不具备对大语言模型的支持功能,但苹果一直在A系列芯片中搭载神经引擎(NPU),持续提供人工智能功能。

如果苹果开始支持大语言模型,那么很可能会在操作系统层面提供支持,并与芯片形成“联合舰队”。其中的核心就是神经引擎。

苹果自iPhone十周年纪念机型iPhone X所采用的A11芯片开始,就搭载了神经引擎。苹果推出的全球首款3纳米制程消费级设备用半导体A17 Pro,被评价为中央处理器(CPU)性能提升不及预期,但神经引擎却不同。苹果称,与前代A16相比,A17 Pro的神经引擎速度提升了两倍。第一代神经引擎每秒可进行6000亿次运算,而A17 Pro每秒可进行35万亿次运算,性能提升约58倍。人工智能功能所需的“体能”也相应大幅增强。

美国信息技术专栏作家Tim Bajarin也指出,在iPhone 15 Pro上最值得关注的部分,正是神经引擎的进化。他自信地表示,A17 Pro芯片中的神经引擎与GPU一起,是半导体部分最关键的组成。若苹果不是强化CPU,而是重点强化神经引擎与GPU,那么其未来布局非常明确——就是人工智能。

Bajarin认为,尽管有部分媒体指出苹果在人工智能竞争中落后,但一直重视端侧人工智能而非服务器端人工智能的苹果,通过强化神经引擎,反而能够更快地处理基于云服务器的人工智能功能。

即便在苹果操作系统iOS 18层面提供对大语言模型的支持,也很难让所有使用同一操作系统的iPhone都具备相同功能。苹果一贯根据芯片性能,对应用层面的新服务进行限制。最具代表性的例子就是Apple Music提供的“Sing”功能。该功能在播放音乐时,仅消除歌手人声,相当于让iPhone秒变“卡拉OK机”。

“Sing”是iPhone代表性的人工智能功能之一,但并非所有iPhone都能使用。苹果只允许搭载A13及之后芯片的iPhone和iPad使用这一功能,因为iPhone所用A系列芯片中神经引擎的性能各不相同。甚至连目前最新的A17 Pro,也有可能无法支持苹果版大语言模型,因为大语言模型极有可能需要更强大的神经引擎算力。

与CPU功能相比,人工智能功能发展更为迅速,但消费者目前仍难以切身感知。要让消费者真正利用智能手机的人工智能功能,必须大幅强化智能语音助手功能。苹果试图大幅扩展现有人工智能助手“Siri”的功能,原因正在于此。如果Siri能够真正执行大语言模型功能,那么超过10亿的iPhone用户就能立刻感受到人工智能的性能。相比必须通过单独的应用或网页进行提问的大语言模型,消费者将能更轻松地接触人工智能。

Bajarin推测,通过人工智能强化Siri的性能,神经引擎将发挥巨大作用。他尤其指出,认为苹果在人工智能方面落后的批评本身就有问题。他回忆称,知名人工智能学者李开复(Kai-Fu Lee)在1991年就职于苹果时,已经在从事基于人工智能的语音识别工作,并补充说,李开复对苹果早期人工智能研究产生了重大影响。在此之前,苹果自1987年起就开始研究由人工智能算法驱动的“知识导航器(knowledge navigator)”概念,这是当时首席执行官John Sculley提出的构想。Bajarin强调,苹果已经在多种产品、应用和服务中应用了人工智能。

可以预期,苹果的人工智能攻势将有望在计划于2024年6月举行的苹果全球开发者大会(WWDC)上正式亮相。

高通和三星也不能落后。安卓阵营中堪称“芯片领头羊”的高通,公开表示其最近推出的“骁龙8第三代”芯片的核心就是神经引擎。三星也宣称,新款Exynos 2400芯片的神经引擎速度比以往提升了14.7倍,并预告其自研大语言模型“Gauss”即将登场。

版权所有 © 阿视亚经济 (www.asiae.co.kr)。 未经许可不得转载。

英伟达革命唤醒苹果的AI本能](https://cphoto.asiae.co.kr/listimglink/1/2023120311300474628_1701570604.png)

![“韩国综指3000点时犹豫的人,如今仍未进场”掌管7万亿资产大户称“机会尚在”[富人投资战略]⑦](https://cwcontent.asiae.co.kr/asiaresize/93/2026050715101553735_1778134216.jpg)