칩-메모리 사이 거리 2배 늘린 칩렛

HBM 20개 붙여 용량 극대화 노려

인공지능(AI) 기업들의 경쟁이 심화하면서 핵심 부품인 메모리가 품귀 현상을 겪고 있다. 이런 가운데 챗GPT로 유명한 오픈AI가 고대역폭메모리(HBM) 20개를 이어 붙인 '괴물 칩' 특허를 공개하면서, 메모리 부족은 더 극심해질 수 있다는 전망이 제기된다.

오픈AI는 지난 9일(현지시간) 미 특허청에 반도체 관련 특허를 출원했다. 해당 특허 제목은 '인접하지 않은 HBM 칩렛과 입출력(I/O) 칩렛, 그리고 임베디드 로직 브리지를 통한 컴퓨트 칩렛'으로, 여러 종류의 칩을 하나의 덩어리처럼 만들어주는 후공정 기술인 '칩렛'을 다룬다.

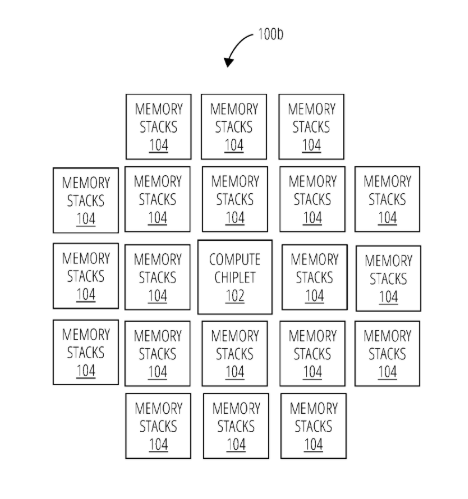

오픈AI가 고안한 인공지능(AI) 칩 디자인. 중앙의 핵심 칩 주위를 고대역폭메모리(HBM)가 에워싸고 있는 모습. 오픈AI

칩렛 자체는 새로운 기술이 아니다. 이미 엔비디아, 애플, 인텔, AMD 등 반도체 기업들은 칩렛을 활용해 여러 칩을 레고 블록처럼 조립해 성능을 극대화하고 있기 때문이다. 다만 오픈AI는 이 특허에서 'HBM을 최대 20개까지 이어 붙일 수 있는 칩렛'을 구현했다.

현재 엔비디아의 그래픽처리유닛(GPU)은 칩 한 개당 4~8개의 HBM을 이어 붙여 외장 메모리를 구축한다. 칩 한 개에 20개의 HBM을 붙일 수 있다면, 엔비디아 GPU 대비 최소 2배 이상의 저장 용량을 갖춘 슈퍼 AI 칩이 탄생하는 셈이다.

반도체 기업들은 AI 칩 사방에 HBM을 연결해 메모리를 확대하는 전략을 고수하고 있지만, 이같은 설계에는 물리적 한계가 있다. 국제 표준(JEDEC)은 신호 감쇠(거리가 멀어질수록 통신 신호가 불안정해지는 현상)를 방지하기 위해 칩과 메모리 사이의 연결 거리를 6㎜로 제한하기 때문이다.

오픈AI의 칩렛 특허는 '임베디드 로직 브리지'라는 능동 회로를 탑재해 해당 연결 거리를 6㎜에서 16㎜로 대폭 연장한다. 덕분에 AI 칩과 직접 맞닿지 않아도 HBM을 '연결'할 수 있게 된다. 실제 오픈AI가 묘사한 디자인을 보면, 핵심 칩을 중심으로 HBM 수십 개가 뻗어나 마치 군집과 같은 형태를 이루고 있다.

그러나 해당 칩이 구체화하려면 연결 제약 외에도 넘어야 할 기술적 난제가 많을 것으로 보인다. 일례로 수십 개의 칩이 한 번에 연결되면서 나타나는 극심한 발열 문제를 해결해야 한다.

한편 오픈AI는 지난해 10월부터 미국 반도체 설계업체 '브로드컴'과 손잡고 맞춤형 AI 칩을 개발 중이다. 오픈AI는 자사 칩에 삼성전자 HBM4를 탑재할 예정인 것으로 전해졌다.

임주형 기자 skepped@asiae.co.kr

<ⓒ투자가를 위한 경제콘텐츠 플랫폼, 아시아경제(www.asiae.co.kr) 무단전재 배포금지>