압축기술로 저장공간 확보

빨라진 속도 검증된다면

오히려 반도체 소비 촉진

최근 터보퀀트 쇼크는 과도

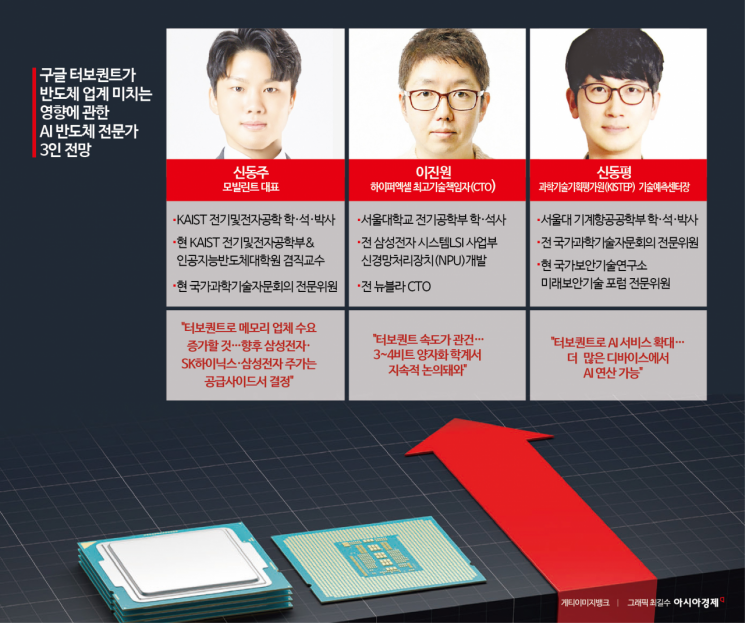

"전 세계 인공지능(AI) 업계 관심이 오는 23~27일 브라질 리우데자네이루에서 열리는 세계인공지능학회(ICLR)에 쏠려 있어요. 구글이 공개한 AI 메모리 압축 기술인 '터보퀀트'에 대한 구체적인 검증이 이뤄질 예정이기 때문이죠."(신동주 모빌린트 대표)

구글이 AI 분야 3대 학회 중 하나인 ICLR에서 터보퀀트 관련 논문을 공식 발표하고, 동료 연구자들의 검증을 거쳐 오는 6월께 실제 프로그램 코드를 전 세계에 공개한다. 구글리서치 블로그에 터보퀀트 논문이 공개되면서 세계 메모리 반도체 시장 파장에 대한 논쟁이 불붙은 지 한 달 만이다.

터보퀀트는 거대언어모델(LLM)이 문맥을 기억하는 'KV캐시(임시 메모리)'를 압축하는 알고리즘이다. 압축을 통해 메모리 사용량을 6분의 1로 줄이면서 세계 메모리 반도체 시장을 장악하고 있는 삼성전자와 SK하이닉스에 악재가 될 것이란 우려가 커졌다. 그러나 학계와 AI 반도체 업계를 중심으로 이 같은 시장의 '터보퀀트 쇼크'가 과도하다는 반론에 무게추가 옮겨가고 있다.

구글 양자화 방식 아이디어 좋아…"인프라 확대 기여할 것"

이진원 하이퍼엑셀 최고기술책임자(CTO)는 "그동안 학계는 16비트로 저장하던 KV캐시를 양자화 방식으로 3~4비트로 압축해 구조적으로 최적화하는 기술을 지속적으로 논의해왔다"면서 "구글의 양자화 방식 자체가 좋은 아이디어인 것은 맞으나 4비트 양자화가 완전히 새로운 것은 아니다"고 진단했다.

이 CTO는 "터보퀀트는 AI 모델의 효율화를 높임으로써 비싼 비용 문제로 엔비디아의 그래픽처리장치(GPU)를 사용하지 못했던 기업의 수요까지 늘릴 것"이라며 "오히려 ICLR 학회에서 터보퀀트가 메모리 저장 공간을 효율적으로 확보한 것은 물론 속도가 목표대로 빨라진 것이 제대로 검증된다면 반도체 소비를 촉진하는 계기가 될 것"이라고 말했다. 메모리 사용량이 6분의 1로 줄어든 것은 효율성을 높여 복잡하고 방대한 AI 서비스를 구현할 수 있다는 의미이며, 이는 결국 메모리 반도체 생산업체의 파이를 줄이는 것이 아니라 인프라 확대를 통한 수요 증가로 이어질 것이란 설명이다.

신동주 모빌린트 대표 역시 "터보퀀트 같은 효율화된 기술로 기존에 쓰이지 못했던 분야까지 시장이 커지면서 메모리 반도체 수요도 계속 늘어날 것"이라며 "미 마이크론, 삼성전자 , SK하이닉스 3사 간 경쟁과 캐파(생산능력) 증설을 둘러싼 눈치 게임, 중국 메모리 업체의 추격 등 공급 쪽 이슈가 향후 삼성전자와 SK하이닉스 주가 방향성을 결정할 것"이라고 했다.

이어 "신경망처리장치(NPU) 기업들은 터보퀀트와 같은 메모리 병목 현상을 해결할 수 있는 알고리즘을 하드웨어에 반영하는 게 중요해진 시기를 맞이하고 있다"면서 "NPU 시장이 확대되고 있는데 만약 터보퀀트 다음 세대 파격적인 알고리즘이 나왔을 때 그 알고리즘을 지원하지 못하는 NPU에는 굉장히 위험할 수 있다"고 전망했다.

신동평 과학기술기획평가원(KISTEP) 기술예측센터장은 "터보퀀트는 하드웨어 문제를 소프트웨어로 해결하려는 시도의 일환"이라며 "터보퀀트의 영향으로 장기적으로 AI 서비스가 확대되고, 더 많은 디바이스(기기)에서 AI 연산이 가능해져 온디바이스 AI 시장도 확대될 것"이라고 말했다.

신 센터장은 앞으로 AI 시장 패러다임을 바꿀 주요 전환점으로 '포스트 트랜스포머 AI 모델'의 등장을 꼽았다. 그는 "기존 트랜스포머를 대신할 수 있는 새로운 모델이 지속적으로 제시되고 있다"며 "향후 포스트 트랜스포머 AI 모델의 등장은 그래픽처리장치(GPU) 우위의 AI 반도체 시장이 근본적으로 바뀔 수 있는 최대 변수로 작용할 수 있다"고 내다봤다.

서소정 기자 ssj@asiae.co.kr

<ⓒ투자가를 위한 경제콘텐츠 플랫폼, 아시아경제(www.asiae.co.kr) 무단전재 배포금지>