AI生成的“贫困之脸”……生成式AI图像副作用惹争议

by Heo Midam

Published 01 Nov.2025 06:30(KST)

“AI时代,人权敏感度正遭遇考验”

随着人工智能(AI)技术在日常生活各个领域迅速扩散,由此带来的副作用也接连出现。有人道主义团体在宣传活动中使用由AI生成的虚假图像,抖音海外版TikTok等平台上则传播着虚假AI视频,甚至引发警方出动的事件。

使用AI图像开展宣传活动……被批为“贫困色情”

近日,英国日报《卫报》指出:“由AI生成的虚假‘贫困色情’图像正被用于人道主义团体的宣传活动”,“在诸多忧虑声中,人权保护原则正在被破坏。”报道称,由于AI图像制作成本低廉且无需经过肖像权同意程序,因此在人道主义团体之间颇受青睐。一些团体不再使用真实人物,而是利用AI生成的虚构人物来描绘贫困和饥饿的现实,诸如蜷缩在泥潭中的儿童、身穿婚纱的非洲少女等AI图像,已经出现在实际的宣传活动中。

对此,比利时安特卫普热带医学研究所研究员Arsenii Alenichev将其界定为“贫困色情”。也就是说,将贫困当作激发情绪的工具来利用。Alenichev表示,“端着空盘子的孩子、龟裂的大地等典型的‘贫困象征’被不断重复”,并称“这些图像正在不断再生产关于非洲或印度等地的最恶劣刻板印象”。

过去主要慈善机构也曾利用AI图像进行宣传。英国慈善机构“国际计划组织”(Plan International)的荷兰分部在2023年反对童婚的宣传视频中,使用了“淤青眼睛的少女”“上了年纪的男子与怀孕的十几岁少女”等AI生成图像。联合国(UN)同样在去年通过YouTube公开了一段以再现方式呈现冲突中性暴力幸存者证词的AI视频。然而,由于该视频让人难以区分事实与虚构,被指“破坏了信息的真实性”,最终在争议声中被删除。

国际非营利组织沟通顾问Kate Kardol也表示:“如今,为了实现伦理表达而展开斗争的舞台,已经从‘现实’扩展到‘虚假世界’”,并称“AI时代的人权敏感度正面临严峻考验”。

渗入个人日常的AI……误认虚假视频导致警方出动

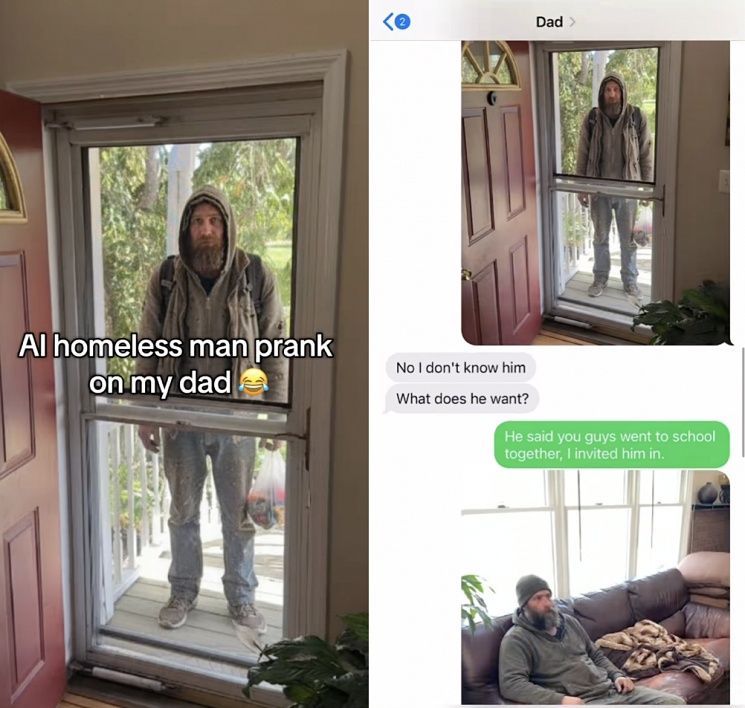

AI图像的误用已经渗入个人的日常生活。任何人都可以通过AI轻易生成图像,现实与虚构的界限被模糊不清的现象愈发严重。由此,AI可能引发犯罪或社会混乱的担忧被提出。实际上,据英国广播公司(BBC)报道,近期在社交媒体上,“AI流浪汉(AI homeless man)”恶作剧扩散开来,警方不得不出面警告。这种恶作剧的方式,是将由AI生成、看上去像陌生男子闯入家中的图像等发给家人。图像是利用谷歌的生成式人工智能“Gemini”等制作的,精细程度与真实照片极为相似。

这一类恶作剧发展为真实报警的案例也曾出现。在英国西南部多塞特郡,一名十几岁少女向父母发送了一条消息:“这名男子闯进了我们家,而且拒绝离开”,并附上由AI生成的图像。父母误以为真的有人入侵,随即报警,警方因此紧急出动。警方事后表示,“动用了本可用于实际紧急情况的宝贵资源”,并提醒称,“如果从家人或朋友那里收到这类图像或信息,在拨打英国紧急电话999之前,应先确认是否为恶作剧。”在美国华盛顿州奥克港高中,也曾出现“学校周边有流浪汉徘徊”的社交媒体帖子,但调查结果显示,这是AI篡改的产物。

在这种情况下,警示AI引发诈骗或操纵风险的声音也日益高涨。OpenAI首席执行官(CEO)Sam Altman在去年7月联邦储备制度(Federal Reserve)举办的“AI对经济与社会影响”相关访谈中表示:“AI已经彻底削弱了大多数认证方式的效力”,并称“目前还停留在利用(滥用AI的)语音通话进行诈骗的程度,但很快就会出现与现实难以区分的视频通话”。